Группа исследователей из ведущих университетов США и Европы опубликовала результаты масштабного эксперимента, показавшего, что современные большие языковые модели, такие как GPT-4, способны деанонимизировать авторов текстов с точностью, значительно превышающей предыдущие методы. В ходе исследования модели анализировали стилистические «отпечатки пальцев» в письменной речи — уникальные комбинации лексики, синтаксиса и ритма. На массиве из десятков тысяч постов с платформ вроде Reddit и Twitter ИИ успешно сопоставлял анонимные сообщения с реальными профилями авторов, в некоторых случаях достигая точности выше 90%. Работа, препринт которой появился в открытом доступе в начале этого месяца, еще не прошла полноценное рецензирование, но уже вызвала резонанс в научном и ИТ-сообществе.

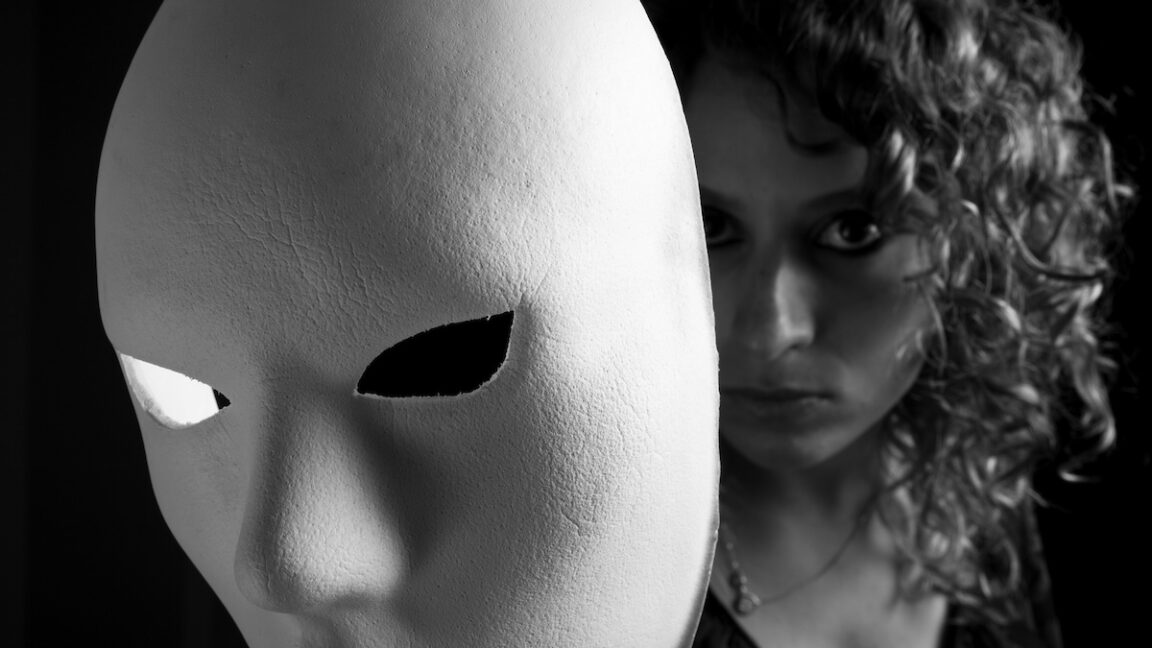

Контекст этой работы критически важен для понимания цифровой приватности. Десятилетиями псевдонимы и аватары считались надежным щитом, позволяющим пользователям свободно выражать мнение, исследовать свою идентичность или обсуждать деликатные темы без страха расправы или дискриминации. Анонимность лежит в основе многих онлайн-сообществ, журналистских расследований и политического активизма. Однако развитие ИИ, особенно моделей, обученных на колоссальных объемах текстовых данных, создало качественно новую угрозу. Если раньше деанонимизация требовала ручного анализа или узкоспециализированных алгоритмов под конкретного автора, то теперь LLM могут делать это массово и автоматически, выявляя закономерности, неочевидные даже для человеческого глаза.

Технически метод исследователей основан на способности LLM формировать высокоуровневые семантико-стилистические представления текста. Модель сначала «читает» известные тексты целевого автора, вычленяя устойчивые паттерны: любимые словечки, длину предложений, структуру аргументации, даже характерные ошибки. Затем этот цифровой «стилевой профиль» используется для анализа анонимного текста. Ключевое отличие от старых методов — LLM не просто ищет ключевые слова, а понимает контекст и тонкие нюансы авторского слога. В эксперименте участвовали несколько моделей, включая коммерческие и открытые. Наиболее эффективными оказались самые крупные и современные из них, что указывает на прямую связь между мощностью модели и ее способностью к деанонимизации.

Реакция экспертов по кибербезопасности и цифровым правам была незамедлительной и тревожной. Специалисты называют исследование убедительным доказательством эрозии анонимности в эпоху ИИ. «Это не теоретическая угроза, а работающий инструмент, который уже сегодня могут использовать как корпорации для сбора данных, так и репрессивные режимы для поиска инакомыслящих», — заявил один из аналитиков. Представители компаний — разработчиков LLM пока не дали официальных комментариев, однако в индустрии, по данным источников, началось внутреннее обсуждение этических рамок и потенциальных ограничений подобного применения их технологий. Критики также указывают, что исследование может стать инструкцией для злоумышленников, хотя авторы работы намеренно опустили некоторые технические детали, чтобы избежать этого.

Для индустрии это означает надвигающийся кризис доверия. Платформы, позиционирующие анонимность как ключевую фичу, могут столкнуться с массовым оттоком пользователей. Под угрозой окажутся бизнес-модели, основанные на сборе и анализе «обезличенных» данных — их теперь можно будет снова привязать к конкретному человеку. Для обычных пользователей последствия еще серьезнее: под угрозой безопасность диссидентов, журналистов-расследователей, сотрудников корпораций, сообщающих о нарушениях, и просто людей, ведущих деликатные блоги под псевдонимами. Право на анонимное высказывание, фундаментальное для свободного интернета, оказывается под вопросом.

Перспективы теперь зависят от гонки технологий и регулирования. С одной стороны, будут развиваться и совершенствоваться методы деанонимизации, возможно, их интегрируют в коммерческие сервисы. С другой — начнется активная работа над контрмерами: ИИ-инструментами для маскировки стилистического «почерка», которые будут автоматически переписывать текст, сохраняя смысл, но меняя стиль. Юристы прогнозируют волну новых законопроектов, ограничивающих использование ИИ для деанонимизации без судебного решения. Однако глобальность интернета делает любое регулирование крайне сложным. Открытым остается главный вопрос: сможем ли мы в принципе сохранить цифровую анонимность, или она неизбежно станет пережитком дороботовой эпохи?

Комментариев пока нет. Будьте первым!