LLMWise

Предоставляет единый API для доступа, сравнения и комбинирования результатов ведущих языковых моделей.

Вы владелец этого сервиса?

Подайте заявку чтобы публиковать обновления, новости и отвечать пользователям.

Войдите в аккаунт чтобы подать заявку

ВойтиОписание

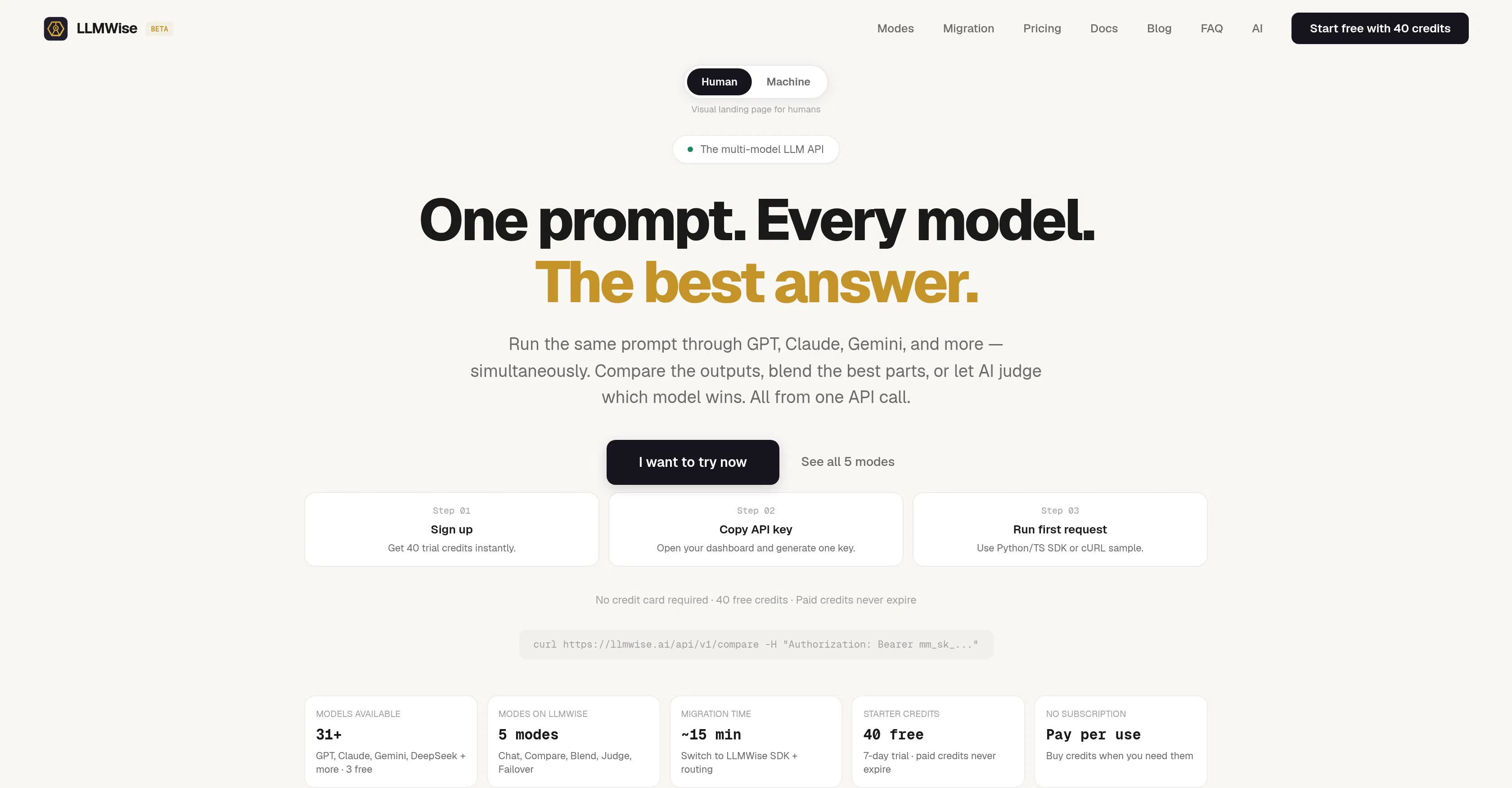

LLMWise — это мультимодельный API для работы с большими языковыми моделями (LLM), созданный для консолидации доступа к разнообразным ИИ-системам. Его главная ценность заключается в том, что он устраняет необходимость интеграции с множеством отдельных провайдеров, предлагая единую точку входа для работы с такими моделями, как GPT-5.2, Claude, Gemini, DeepSeek, Llama и Grok. Это позволяет разработчикам и компаниям значительно упростить свой стек технологий, связанных с ИИ, и сосредоточиться на создании приложений, а не на управлении подключениями.

Основные возможности: единый API-ключ для работы с десятками моделей от разных поставщиков; функция сравнения ответов от нескольких моделей на один и тот же запрос в параллельном режиме; технология "смешивания" (blending), которая позволяет автоматически комбинировать лучшие фрагменты ответов от разных ИИ для создания оптимального результата; интеллектуальная маршрутизация запросов к наиболее подходящей модели на основе стоимости, скорости или требуемого качества; встроенные инструменты для тестирования и оценки производительности моделей; а также централизованное управление квотами и расходами.

Ключевым техническим отличием является слой абстракции, который стандартизирует взаимодействие с разными API, имеющими свои особенности. Платформа предлагает детальную аналитику по использованию, включая задержки, стоимость и успешность запросов. LLMWise легко интегрируется в существующие проекты через REST API и предоставляет SDK для популярных языков программирования, что делает его удобным для разработчиков. Модель freemium позволяет начать работу с бесплатным лимитом запросов.

Идеально подходит для разработчиков, которые создают приложения с ИИ и хотят избежать vendor lock-in, а также для исследователей и аналитиков, сравнивающих эффективность разных языковых моделей. Сервис полезен стартапам, которым нужна гибкость и отказоустойчивость в выборе провайдера ИИ, и компаниям, стремящимся оптимизировать затраты на генеративный ИИ, автоматически направляя задачи к самым экономичным моделям. Сценарии использования варьируются от создания чат-ботов и ассистентов с повышенной надежностью до массовой генерации контента с последующей автоматической выборкой наилучших вариантов.